log20250812-VMD数据转为Retarget的可能性

之前log20250810-记G1 MMD化过程说到,我将URDF转置拼接成为了MMD的模型,成功跳起了舞蹈:G1绑定测试G1_29DOF模型:Unitree绑定:自制动作数据:Seto编舞:Atlus(女神异闻录4)音乐:Specialist by At…_哔哩哔哩_bilibili

不过,这个版本有很多瑕疵。主要冲突点在于MMD的骨骼为全仿人骨骼,但人类的一些节点是全向球形骨骼,如肩部、胯部。一些如肘部、膝盖等单维度旋转的映射比较简单,但球状关节往往被映射在旋转中心不同的两个单维度自由度上(电机的解决方案)。

G1普遍使用了球外延申刚体放弃球内维度的方法(即将全向分解为两个单维度自由度来满足IK解算要求,舍弃一个自由度在关节内的物理移动,来保证末端执行器的范围和球状关节基本一致)。非常聪明的方法,让还原可以通过函数计算实现。通过放弃一定的自由度,也可以完成基本的需求,于是得到了:log20250812-手机支架。

在探索的过程中,通过Blender进行组合能够完美完成需求。那时动态的动作不过只是整活驱动,从VMD Retarget到类似于LAFAN1这样的数据集几乎是很难实现、需要自己打通通道。

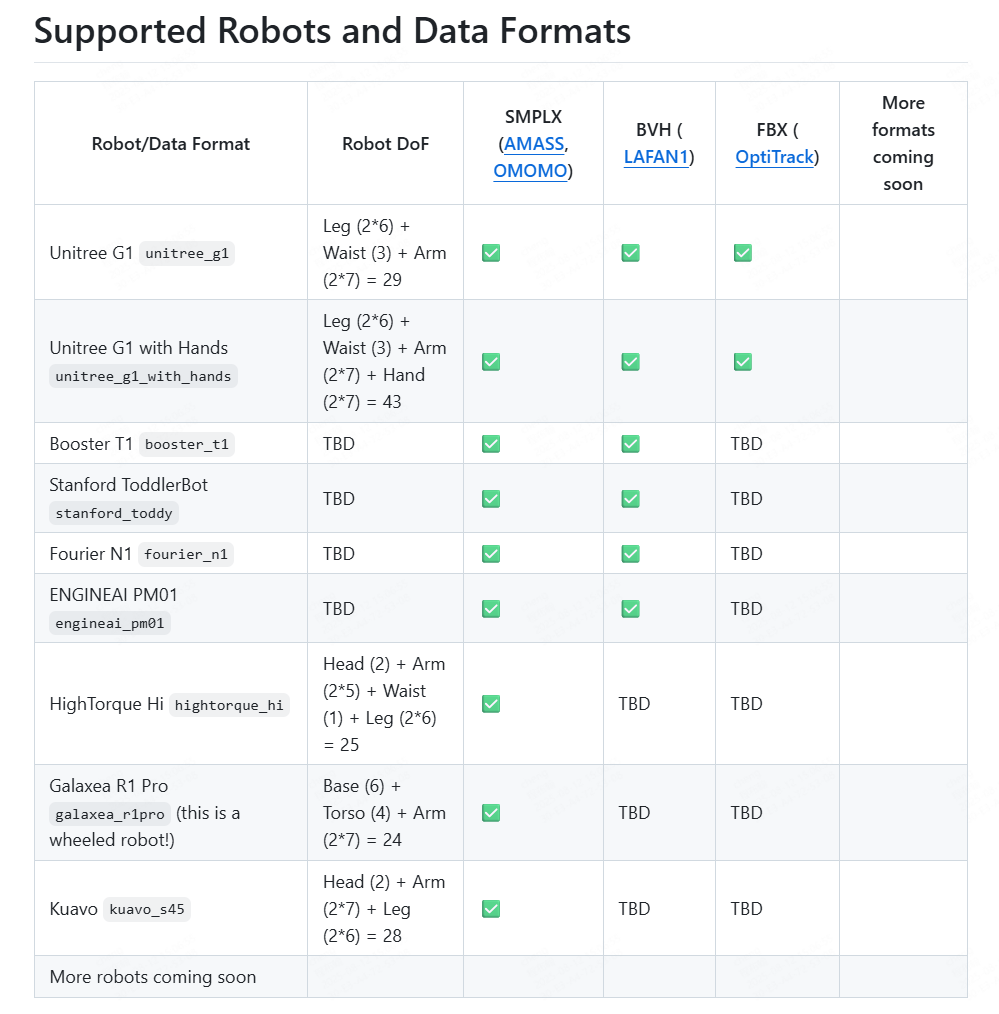

直到我看到了一个项目——Amazon FAR的YanjieZe/GMR: GMR: General Motion Retargeting. Retarget human motions into diverse humanoid robots in real time on CPU. Retargeter for TWIST.

该项目支持从Blender导出的BVH动补数据进行映射。非常有前景,值得一试。

当然,最后一公里的Retarget→Locomotion还需要找方法。